L’intelligenza artificiale, anche nella declinazione che abbiamo imparato a conoscere utilizzando l’AI generativa (GenAI) conversazionale, mostra tutto il suo potenziale non solo utilizzata con le funzionalità tipiche dei chatbot, ma integrata in modo intelligente nelle applicazioni per il business. Un interesse rispecchiato anche dall’esplosione di questo mercato che secondo gli analisti vale già quasi 45 miliardi di dollari ma crescerà fino a superare i 207 miliardi entro il 2030. La GenAI promette benefici significativi in vari settori, basterebbe pensare alla sanità, all’elaborazione delle immagini mediche ed alla relativa velocità e puntualità nelle diagnosi, all’accelerazione nello sviluppo di codice per i software per la ricerca volta a migliorare la salute. In verità, questi due piccoli esempi aiutano a comprendere come tutti i verticali siano già o saranno a breve impattati dal potenziale dell’AI. Così tutta l’industria impegnata nella creazione dei contenuti, ovviamente ogni settore IT, a partire dallo sviluppo e dalla cybersecurity, ma anche l’employee e la customer experience.

Tuttavia, l’AI generativa solleva anche preoccupazioni e timori riguardo a disinformazione, violazioni della privacy, pregiudizi, deepfake e per questo l’adozione responsabile dell’AI generativa è fondamentale per accrescere la fiducia e garantire che le capacità di GenAI siano imparziali, veritiere e sicure.

ServiceNow, piattaforma cloud leader nella digitalizzazione dei processi aziendali e continua innovatrice nel campo dell’AI, per prima ha definito una serie di best practice e standard per impegnarsi a utilizzare l’AI in modo responsabile per il bene delle persone e l’interesse dei suoi clienti.

ServiceNow, AI responsabile e principi guida

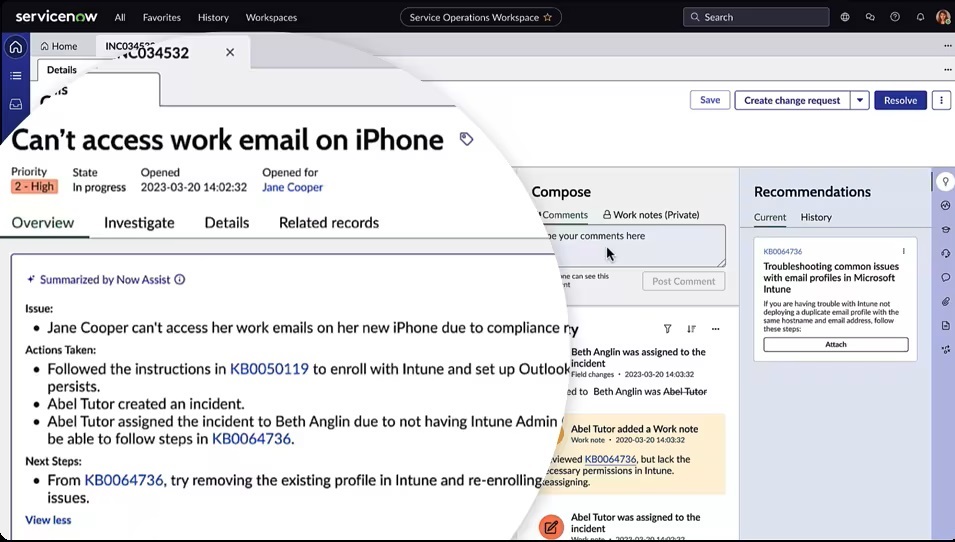

ServiceNow, lo sappiamo, vanta già una lunga esperienza nella capacità di sfruttare l’AI, per esempio attraverso i chatbot intelligenti, presenti nativamente da molti anni nella sua piattaforma cloud, insieme a machine learning e intelligenza predittiva. Oggi tutta la proposizione dell’azienda fa leva sulle potenzialità di questi abilitatori digitali. Non solo: con il rilascio di una serie di soluzioni di AI generativa conosciute come Now Assist, oggi ServiceNow prosegue il suo percorso d’innovazione per supportare la crescita di produttività e l’efficienza operativa dei propri clienti.

Affidabilità e responsabilità restano in ogni caso i capisaldi di riferimento nel solco dei quali ServiceNow indirizza gli sviluppi della sua Now Platform.

In particolare ServiceNow abbraccia quattro principi guida che permeano il suo approccio all’utilizzo dell’AI, in modo da poterla utilizzare in modo responsabile.

Il primo riguarda la centralità dell’uomo (1). ServiceNow documenta come e dove viene utilizzata l’intelligenza artificiale, fornendo indicazioni su come implementare l’AI in modo responsabile. Sono quindi i clienti a decidere dove e quando utilizzare l’AI e ServiceNow garantisce che questa sia utilizzata nel rispetto dei principi umani, riservando alle persone il pieno controllo sulle decisioni basate sull’intelligenza artificiale.

Per quanto riguarda bias e pregiudizi (2), l’azienda è convinta che l’AI abbia il potenziale di ridurre la complessità e migliorare la qualità della vita delle persone e si impegna a costruire modelli con set di dati che riflettano l’effettiva diversità di clienti e persone, così come si impegna nel testing continuo volto alla verifica di eventuali criticità legate ai bias. Non solo, l’AI di ServiceNow vuole essere trasparente (3) attraverso una comunicazione chiara e diretta con i clienti. Significa garantire la descrizione dei limiti e dell’utilizzo previsto dei prodotti, nonché la comunicazione riguardo l’utilizzo dei dati sfruttati per la generazione dei modelli e l’approccio relativo a privacy e sicurezza.

Ultimo ma non ultimo, la responsabilità (4): ServiceNow ha creato una struttura specifica di supervisione per garantire responsabilità e governance e lavora a stretto contatto con esperti esterni e con le comunità di riferimento sull’AI, oltre a disporre di organi di governance interni, per supervisionare le attività di sviluppo sui prodotti.

La strategia di ServiceNow prevede l’integrazione nativa delle soluzioni presenti in piattaforma con le funzionalità messe a disposizione da Now Assist, evitando l’uso di AI generative di terze parti. Questo consente una copertura più efficace e precisa dei casi d’uso aziendali, fornendo alla GenAI l’accesso a dati contestuali ai workflow digitalizzati e garantendo una maggiore precisione nelle risposte fornite. Tra le funzionalità più interessanti, ad esempio, vi è la possibilità di utilizzare GenAI specializzate per supportare i team di sviluppo nella generazione di codice sorgente, garantendo elevati livelli di sicurezza attraverso la Now Platform.

La GenAI integrata consente inoltre a ServiceNow di avere un controllo molto più stretto su ciò che la GenAI fa e su come si comporta. L’azienda ha messo in atto procedure e best practice con le quali è in grado di valutare le prestazioni dei LLM, identificare e mitigare i rischi di bias o output problematici e adattare i grandi modelli linguistici ai casi d’uso richiesti dai propri clienti. In modo più ampio, ServiceNow è in grado di seguire le proprie linee guida sull’AI, ponendo attenzione agli impatti che essa può avere sul lavoro delle persone e che sono fondamentali per lo sviluppo di un’AI responsabile. L’approccio integrato adottato da ServiceNow permette di rispondere anche alle preoccupazioni in materia di sicurezza e privacy, poiché le funzionalità GenAI sono vincolate da logiche di controllo degli accessi (ACL) e protette dalla sicurezza nativa fornita dalla Now Platform.

Large Language Models, il valore della proposta ServiceNow

Sono utili però ulteriori precisazioni per rendere più evidente il valore della proposta di ServiceNow. Abbiamo già accennato a come ServiceNow forma i propri modelli di linguaggio di grandi dimensioni (LLMs), integrando direttamente l’AI generativa nella Now Platform anziché usare un motore GenAI di terze parti. Questo permette un maggiore controllo sui Large Language Models e sui dati di addestramento. Si parte da un modello ‘base’ fondato su tecnologia GenAI standard di settore, lo si addestra con dati accuratamente selezionati, escludendo quelli personali e specifici forniti dai clienti, che hanno la possibilità di fornire dati anonimizzati. Questo approccio di addestramento è cruciale per garantire modelli sicuri e privi di bias e pregiudizi, rendendo i modelli GenAI più affidabili e permettendo a ServiceNow di essere completamente trasparente nei confronti dei propri clienti.

La strategia prevede la focalizzazione su casi d’uso specifici attraverso la creazione di modelli di linguaggio di grandi dimensioni ma proiettati a risolvere problemi particolari. Questo approccio, che esclude dati non pertinenti, rende la GenAI di ServiceNow una proposta rilevante e riduce il rischio di risposte inappropriate.

Certo, la Now Platform supporta anche l’integrazione con LLMs di terze parti come Azure OpenAI di Microsoft e PaLM di Google, in questo caso però sono i clienti ad assumersi i rischi associati all’uso di LLM esterni.

Inoltre, poiché la qualità dell’intelligenza artificiale Generativa (GenAI) dipende dai dati su cui viene addestrata, ServiceNow utilizza dati reali per l’addestramento ma ai clienti viene offerta la possibilità di contribuire con i propri dati per migliorare i modelli. Per esempio, le funzionalità di ServiceNow volte alla generazione di codice raccolgono anche le modifiche apportate per analizzare l’interazione degli sviluppatori con il codice generato ed in ogni caso la documentazione completa specifica quali dati vengono raccolti per ogni funzionalità GenAI.

Per garantire la creazione di LLM trasparenti, responsabili, verificabili, ripetibili, sicuri, ServiceNow segue un rigoroso processo di controllo per tutto il ciclo di vita di ogni modello. A partire da un modello base di riferimento (per esempio Nvidia NeMo e StarCoderBase per la generazione automatica di codice) viene effettuato pre-addestramento utilizzando dati ServiceNow attentamente selezionati, così da creare un LLM con l’intelligenza specifica necessaria per i casi d’uso da affrontare. Viene quindi eseguito una sorta di fine tuning delle istruzioni per “incorporare” prompt conversazionali, ottimizzati per il tipo di interazioni che l’LLM dovrà supportare.

Segue quindi la fase di benchmarking per confermare che il comportamento e la funzionalità soddisfino gli standard ServiceNow LLM e il testing avviene con dati specifici per i casi d’uso coperti, assicurando che il comportamento testato sia coerente con quanto atteso. Infine, vengono raccolte metriche e feedback degli utenti dopo il rilascio, per identificare eventuali problemi e indirizzare il ciclo di sviluppo migliorativo.

GenAI e sicurezza, il metodo ServiceNow

Evidente quanto sia prioritario il tema della sicurezza: la Now Platform è sicura per impostazione predefinita, progettata per fornire accesso ai dati in relazione al contesto in cui vengono consumati e solo alle persone che hanno diritto di accedervi. La sicurezza include quindi restrizioni robuste sull’accesso fisico all’infrastruttura cloud, separazione dei task, istanze e database dedicati ai clienti per la corretta segmentazione dei dati, metodi di autenticazione avanzati, controllo degli accessi basato sui ruoli, crittografia dei dati in transito, backup crittografati e monitoraggio completo. Oltre a questo, per GenAI si presta attenzione particolare al trattamento e alla gestione dei dati, mediante la raccolta responsabile dei dati di addestramento per i LLM e il controllo delle richieste di funzionalità di AI generativa che avvengono in ambienti di produzione.

Ad esempio, i dati forniti dai clienti vengono trattati in modo da rimuovere le informazioni personali che potrebbero consentire qualsiasi identificazione e poi inviati all’ambiente di sviluppo ServiceNow in modalità sicura e protetta, accessibile solo agli esperti AI di ServiceNow, senza mai condividerli con altri clienti o terze parti.

ServiceNow e GenAI, un vero cambio di passo perché…

La proposta di ServiceNow è interessante proprio perché l’azienda punta ad indirizzare casi d’uso GenAI specifici dei domini in cui la sua piattaforma e le sue soluzioni sono adottate, in modo da creare valore per il cliente, e assicurandosi che questi scenari siano funzionali ad operare nativamente con i prodotti ServiceNow. Proprio per tale motivo, queste funzionalità sono mirate e subito operative in piattaforma, così da non esporre i clienti ai rischi di governance, accesso e gestione di soluzioni GenAI di terze parti. In pratica non è necessario sviluppare ex novo una strategia per l’AI aziendale prima di implementare la GenAI di ServiceNow.

Ecco allora che integrando le potenzialità dell’AI generativa nella Now Platform, ServiceNow mira a fornire intelligenza specifica per dominio e processo, per supportare concretamente use case rilevanti per i suoi clienti, aumentando il valore delle informazioni storicizzate in piattaforma affinché possano trasformarsi subito in decisioni. Un vantaggio incommensurabile se applicato a specifici casi d’uso e contesti operativi.

Ne abbiamo accennato in particolare nell’introduzione del nostro lavoro, entriamo ora nello specifico dei dettagli con un primo contributo dedicato all’utilizzo dell’AI generativa con ServiceNow per la customer experience. Un ambito sfidante perché, se è vero che le organizzazioni stanno facendo dei progressi nell’implementazione della CX, esistono ampi margini di miglioramento e soprattutto non sono poche le sfide legate all’insoddisfazione dei clienti, anche per i servizi oberati di chiamate che portano il personale sotto pressione. Problemi per risolvere i quali l’AI generativa è un vero game changer.

Non perdere tutti gli approfondimenti della room Digital Workflow by ServiceNow

Per saperne di più scarica il whitepaper Trend dell’esperienza clienti nell’era della GenAI

© RIPRODUZIONE RISERVATA