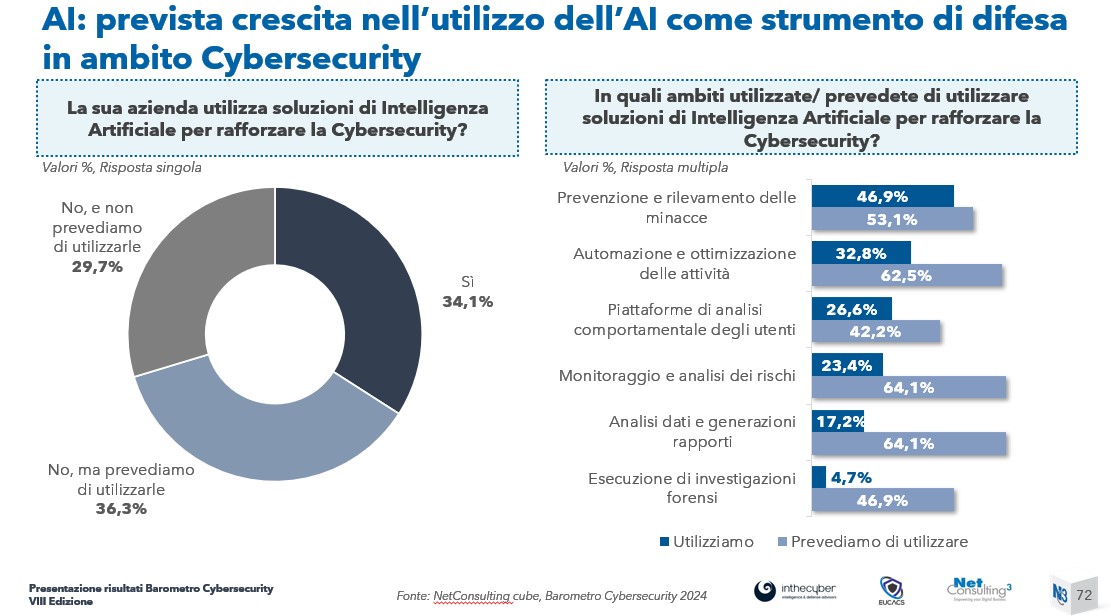

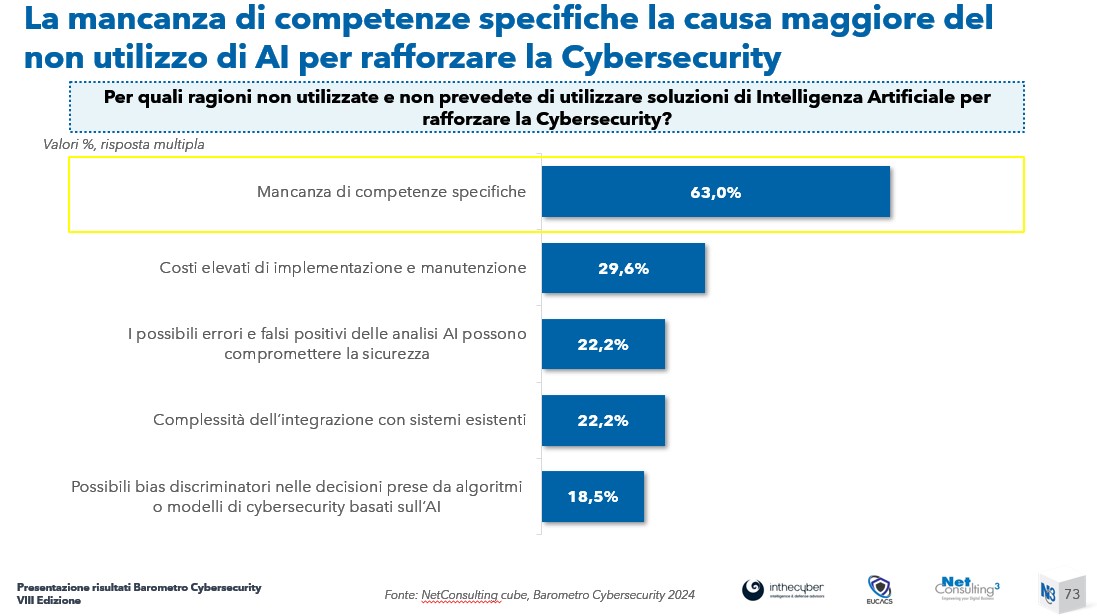

Quando si parla di cybersecurity è ben conosciuto il vantaggio per il cybercrime dell’intelligenza artificiale nel rendere ancora più pericolose le minacce meno invece il ruolo sempre più strategico come strumento di difesa. Secondo l’VIII edizione del Barometro Cybersecurity di NetConsulting cube, oltre un terzo delle aziende italiane (34,1%) utilizza già soluzioni di AI per rafforzare la propria postura di sicurezza, mentre un ulteriore 36,3% prevede di adottarle nel breve periodo. La crescita è trainata soprattutto dall’esigenza di reagire in modo più rapido e preciso a un volume di attacchi in costante aumento, con un focus che si concentra sulla prevenzione e sul rilevamento delle minacce (indicati dal 53,1% delle organizzazioni), sull’automazione e l’ottimizzazione delle attività (62,5%) e sull’analisi dei rischi e dei comportamenti anomali (oltre il 64%). Accanto a queste potenzialità, emergono tuttavia limiti strutturali: il 63% delle imprese che non utilizzano AI individua nella mancanza di competenze specifiche la principale barriera, seguita dai costi di implementazione e dalle difficoltà di integrazione.

Il quadro suggerisce quindi una duplice traiettoria: da un lato, la necessità di colmare il gap di competenze e di governance; dall’altro, l’urgenza di potenziare l’uso dell’AI anche nelle difese, in un contesto in cui la stessa tecnologia è già ampiamente sfruttata dagli attaccanti per automatizzare compromissioni, orchestrare campagne ransomware e generare varianti elusive. Si innesta in questo contesto la strategia di Cynet che fa dell’AI il perno centrale della sua proposta di difesa.

Il valore dell’AI nella cybersecurity

L’intelligenza artificiale applicata alla cybersecurity rappresenta quindi oggi uno dei passaggi più significativi dell’evoluzione dei modelli di difesa. Il concetto non si limita all’impiego di tecnologie avanzate per supportare gli analisti: segna un cambiamento più ampio, in cui algoritmi di machine learning, reti neurali e sistemi di analisi evoluti diventano parte attiva dell’ecosistema di protezione. L’AI in cybersecurity, infatti, non svolge solo funzioni di automazione, ma introduce un paradigma basato sulla capacità di apprendere, interpretare e anticipare comportamenti potenzialmente dannosi a partire da enormi volumi di dati che nessun team umano sarebbe in grado di analizzare con la stessa rapidità. Per anni, le soluzioni di sicurezza hanno utilizzato forme basilari di apprendimento automatico per rilevare anomalie e pattern insoliti. L’obiettivo era intercettare segnali deboli indicativi di una compromissione imminente, spesso prima che il danno fosse evidente. Questo approccio ha permesso di superare i limiti delle tecniche tradizionali, basate su firme statiche e regole predefinite, e ha aperto la strada a modelli capaci di riconoscere anche attacchi non conformi ai pattern noti. L’avvento della generative AI ha ampliato ulteriormente queste possibilità, consentendo un’analisi più profonda dei dati di sicurezza e una capacità inedita di delineare risposte e misure di mitigazione personalizzate. La capacità di generare scenari, simulare attacchi e suggerire contromisure operative sta ridefinendo il modo in cui le organizzazioni interpretano il rischio cyber.

Endpoint protection e malware detection: approccio predittivo

Uno dei primi ambiti in cui l’AI mostra un impatto concreto è la protezione degli endpoint. I tradizionali sistemi basati su firme riescono a identificare solo malware già catalogati, lasciando un ampio margine d’azione alle minacce zero-day o alle varianti create appositamente per eludere i controlli. Con l’inserimento di modelli di machine learning addestrati su dataset estesi, la detection diventa più dinamica: i sistemi sono in grado di riconoscere segnali di comportamenti sospetti analizzando esecuzioni, processi, comunicazioni, interazioni tra file e memoria. In questo modo, la protezione degli endpoint si trasforma da esercizio reattivo a processo predittivo, capace di intercettare anche minacce mai viste prima. L’AI non solo accelera l’analisi, ma migliora anche la qualità del rilevamento. La correlazione tra attività osservate su centinaia o migliaia di endpoint consente di individuare comportamenti anomali che, singolarmente, non sarebbero significativi. Questo approccio permette di comporre il quadro complessivo di un attacco prima che l’infezione si estenda ad altri sistemi, riducendo in modo sostanziale la superficie di impatto.

Incident response automatizzati, la velocità fattore critico

Un altro ambito di applicazione dell’AI riguarda l’incident response. Gestire un incidente di sicurezza significa percorrere un processo articolato che richiede tempo: comprendere cosa è accaduto, raccogliere i dati necessari, valutare la gravità dell’impatto e attuare le misure di contenimento. L’intelligenza artificiale interviene proprio su questi colli di bottiglia, automatizzando una parte consistente del ciclo di risposta. L’AI è in grado di analizzare in tempo reale la portata di una minaccia, di valutarne la severità e di attivare risposte predefinite come l’isolamento di un host compromesso o il blocco di una comunicazione sospetta. L’automazione non sostituisce la valutazione umana, ma riduce drasticamente il tempo necessario per neutralizzare la parte iniziale dell’attacco, diminuendo il rischio che il malware possa diffondersi. Il valore aggiunto è doppio: i team di sicurezza vengono sollevati dalla gestione di attività ripetitive e potenzialmente soggette a errore, mentre l’organizzazione guadagna velocità e precisione operativa.

Threat Intelligence, dall’analisi manuale alla correlazione dinamica

Tradizionalmente, la threat intelligence si basa su processi manuali di raccolta e analisi dei dati. Gli analisti devono valutare le informazioni provenienti da feed esterni, log, report di settore e incidenti passati per costruire un quadro coerente delle minacce emergenti. L’AI rivoluziona questo paradigma introducendo capacità di correlazione su larga scala. Sistemi avanzati possono esaminare traffico di rete, comportamenti degli utenti, dati provenienti dagli endpoint e informazioni raccolte da fornitori e comunità globali, restituendo analisi accurate in tempi molto più rapidi. La forza dell’AI nella threat intelligence risiede nella capacità di riconoscere pattern ricorrenti tra migliaia di segnali diversi, identificando nuove famiglie di minacce e collegandole alle tattiche e tecniche utilizzate dagli attaccanti. L’aggregazione di intelligence proveniente da organizzazioni diverse consente inoltre una visibilità più ampia sul panorama delle minacce globali, creando una rete di conoscenza capace di anticipare le mosse dei gruppi criminali.

Generative AI e remediation guidata, la mitigazione autonoma

Uno dei campi più innovativi riguarda l’uso della generative AI per la definizione delle attività di remediation. L’AI generativa, infatti, è in grado di simulare scenari di attacco, stimare l’impatto su specifiche porzioni dell’infrastruttura e proporre contromisure calibrate sulla natura e sulla criticità dell’incidente. In questo modo, la generative AI non solo accelera l’identificazione del rischio, ma affianca gli analisti nella scelta delle risposte più efficaci. Questa capacità si estende anche all’automazione delle attività di correzione: patching, aggiornamento di configurazioni, riscrittura di policy, reindirizzamento dei flussi di rete o sospensione selettiva di servizi. Operazioni complesse, che spesso richiedono ore di intervento umano, possono essere eseguite in modo orchestrato dai sistemi di AI, riducendo drasticamente il tempo necessario a riportare l’ambiente in condizioni di sicurezza.

Il ruolo dell’AI nei processi di compliance

In ambito aziendale, l’intelligenza artificiale è poi sempre più utilizzata anche per gestire aspetti correlati alla compliance. Compilare questionari di sicurezza durante valutazioni di terze parti o audit è un’attività tradizionalmente onerosa e frammentata, che richiede la raccolta di informazioni da diversi dipartimenti. L’AI automatizza questo processo estraendo e aggregando dati da documentazione interna, policy aziendali e strumenti di gestione, garantendo risposte accurate e coerenti. Questo approccio semplifica il processo di revisione e riduce il rischio di incongruenze o errori nei documenti di conformità.

Automazione e consapevolezza situazionale

La crescente adozione dell’AI nella cybersecurity è legata quindi a vantaggi concreti. L’intelligenza artificiale permette di individuare pattern e anomalie non rilevabili dai sistemi tradizionali, migliorando la detection in tempo reale. A ciò si aggiunge la capacità di automatizzare attività ripetitive come l’analisi dei log, il monitoraggio del traffico e la gestione degli alert, riducendo il carico operativo dei team di sicurezza. L’AI consente anche una visione più ampia del contesto, integrando informazioni da più fonti e restituendo una conoscenza situazionale più completa. In questo modo, le aziende possono anticipare le minacce, prevedere l’evoluzione degli attacchi e reagire in modo efficiente.

Le sfide, falsi positivi, privacy e risorse

Nonostante i benefici, l’adozione dell’AI porta con sé sfide di rilievo. La prima riguarda i falsi positivi, che richiedono supervisione umana e rischiano di alimentare l’alert fatigue. La seconda è la tutela della privacy: i sistemi basati su analisi comportamentale devono essere implementati con cautele tecniche e normative per evitare violazioni di dati sensibili. A ciò si aggiunge la necessità di risorse computazionali e competenze specialistiche, che rappresentano barriere soprattutto per le organizzazioni meno mature. Per sfruttare pienamente l’AI nella cybersecurity è fondamentale investire nella qualità del dato, adottare strategie di integrazione che rendano compatibili i sistemi di AI con le infrastrutture esistenti e rafforzare la collaborazione tra algoritmi e analisti. Solo un controllo umano consapevole può garantire che gli output dell’AI siano corretti e rilevanti. Infine, i modelli devono essere aggiornati regolarmente per evitare il deterioramento delle performance in un contesto di minacce in continua evoluzione.

CyAI, motore di rilevamento avanzato delle minacce basato sull’AI

In questo scenario in cui l’AI diventa la componente cardine tanto delle strategie difensive quanto degli arsenali offensivi degli attaccanti, il passo successivo consiste nel comprendere come le piattaforme di sicurezza integrino realmente queste capacità nel proprio modello di protezione. È qui che si innesta la proposta di Cynet, che interpreta l’AI non come un semplice add-on, ma come il motore centrale della propria architettura di rilevamento avanzato.

CyAI, il motore di machine learning proprietario integrato nella piattaforma All-in-One, rappresenta l’evoluzione naturale di quanto descritto finora: uno strato intelligente in grado di analizzare ogni eseguibile, valutarne il comportamento con un punteggio di probabilità e bloccare automaticamente anche le varianti sconosciute o mai osservate prima. Il valore di CyAI emerge nel modo in cui affronta due criticità ricorrenti: la rapidità con cui nascono nuove varianti malware e la gestione del rumore generato da strumenti tradizionali. Il motore riduce fino al 90% i falsi positivi, condizione essenziale per evitare l’affaticamento dei team di sicurezza, e fornisce una protezione immediata anche contro minacce zero-day grazie a un modello continuamente addestrato su milioni di campioni. A ciò si aggiunge la sinergia con il team CyOps di Cynet, che opera come Soc esteso H24, validando gli alert e guidando le azioni successive. In questo modo, l’AI non diventa soltanto un acceleratore tecnologico, ma un fattore abilitante in grado di tradurre l’intelligenza automatizzata in un miglioramento reale della postura di sicurezza delle organizzazioni. Ne parliamo in un contributo dedicato.

Per saperne di più scarica il documento: CyAI, motore di rilevamento avanzato delle minacce basato sull’AI

Leggi tutti gli approfondimenti della Room: Cybersecurity totale senza complessità by Cynet

© RIPRODUZIONE RISERVATA

Immagine di DC Studio su Freepik

Immagine di DC Studio su Freepik