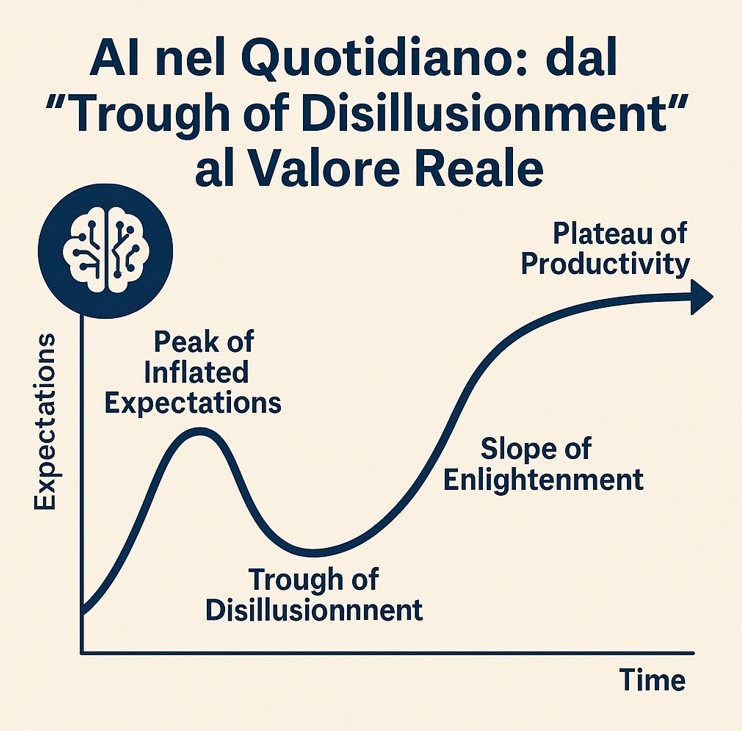

Negli ultimi mesi il clamore intorno all’intelligenza artificiale generativa ha toccato vertici inediti, ma molte aziende convivono ora con una crescente delusione. Secondo un articolo di The Economist, il 42% delle imprese ha abbandonato la maggior parte dei progetti pilota di AI generativa, lamentando investimenti ingenti e risultati scarsi. I Ceo dicono: “Non capisco perché ci stia mettendo così tanto. Ho speso soldi e non vedo risultati”. Parallelamente, uno studio citato su Ssrn (fonte: Social Science Research Network, abstract ID 5219933) evidenzia come la governance dei progetti AI sia spesso trascurata o inadeguata, con conseguente moltiplicarsi di insuccessi e rischi non valutati . Questo “trough of disillusionment” (depressione da disillusione) appare controintuitivo rispetto alle promesse iniziali, ma apre la strada a una riflessione più matura: il vero valore dell’AI emerge quando viene applicata in modo strutturato e governato a processi industriali e di business.

La fase attuale del ciclo dell’hype riflette due criticità principali:

- Limitazioni dell’AI generativa out-of-the-box: molte soluzioni vengono integrate senza un’adeguata personalizzazione sui dati aziendali né un assessment dei processi esistenti, creando un mismatch tra capacità tecnologiche e necessità operative.

- Carente governance interna: Come evidenziato dal report AI Behind Closed Doors (fonte: Cornwell University, Arxiv.org), le decisioni sull’adozione di sistemi AI vengono spesso delegate senza un framework di controllo chiaro, generando “un failure-by-success” dove i primi guadagni mascherano rischi strutturali e lacune nel monitoraggio.

Per superare la soglia di delusione, serve spostare l’attenzione dall’hype verso un approccio “AI del fare”, basato su tre pilastri: qualità dei dati, integrazione end-to-end e governance trasversale.

Applicazioni pratiche

Quando correttamente implementata, l’AI dimostra un valore tangibile in diversi contesti:

- Manutenzione predittiva: nelle linee di produzione, modelli di machine learning possono analizzare dati da sensori IoT per anticipare guasti critici, riducendo i fermi macchina del 30% e contenendo i costi di manutenzione fino al 25%.

- Ottimizzazione della supply chain: algoritmi di forecasting avanzato permettono di regolare dinamicamente livelli di scorte e piani di produzione, migliorando il servizio al cliente e limitando gli sprechi di magazzino.

- Automazione documentale e knowledge management: sistemi Nlp in ambito finanziario o assicurativo accelerano l’elaborazione di pratiche, taggano e classificano automaticamente i documenti, abbattendo i tempi di back-office fino al 50%.

In questi esempi, l’AI non è un “gadget tecnologico”, ma un acceleratore di efficienza che si integra in architetture IT consolidate, con metriche di performance chiare e Kpi misurabili.

Ristrutturare l’approccio all’AI, un racconto di concretezza

Non si tratta più di accumulare enormi quantità di informazioni, ma di trasformarle in un tessuto interconnesso, dove ogni dato ha un ruolo preciso. Immaginiamo un magazzino intelligente capace di integrare dati da sensori industriali, sistemi Erp, Crm e log operativi: non solo uno spazio dove custodire, ma un luogo in cui ogni bit è etichettato, tracciato e verificato. In quest’ottica, indicatori come la completezza delle informazioni, il loro grado di accuratezza e l’aggiornamento in tempo reale lasciano il posto a una vera e propria “sanità dei dati”, monitorata giorno per giorno da dashboard intuitive.

Non servono progetti mastodontici per dimostrare il potenziale dell’AI. In un reparto di produzione, bastano i dati già presenti per far emergere anomalie: un algoritmo predittivo, tarato su segnali di vibrazioni o temperatura, riesce a intercettare guasti con oltre l’85% di affidabilità, evitando fermi macchina che possono costare migliaia di euro ogni ora. Allo stesso modo, chi si cimenta con previsioni di vendita scopre che un semplice modello di serie storiche può ridurre fino al 20% gli scostamenti tra pianificato e reale, portando a un riordino più efficiente e a minori scorte giacenti. Anche i servizi finanziari non sono da meno: un approccio di credit scoring che sfrutta variabili non convenzionali – come pattern di pagamento digitali – migliora di circa il 30% la capacità di individuare clienti a rischio.

Dietro ogni modello c’è un percorso fatto di decisioni: quali dati includere, come bilanciare le differenti provenienze, che livello di spiegabilità rendere disponibile agli utenti. Aziende lungimiranti hanno aperto tavoli di confronto interdisciplinari, dove informatici, legali e risk manager valutano insieme questioni di privacy, bias di genere o geografici e scenari di vulnerabilità. Report periodici, frutto di audit automatici e revisioni manuali, chiariscono se l’intelligenza artificiale sta operando entro confini etici e normativi, mentre piani di emergenza garantiscono un rapido ritorno alle configurazioni stabili in caso di malfunzionamenti.

Il salto di qualità si vede quando un modello non è solo un prototipo, ma un’entità viva all’interno dell’ecosistema operativo. In questa fase, le pipeline di Mlops orchestrano automaticamente test, validazione dei dati, deployment e monitoraggio. Ogni nuova versione del modello è esaminata per cogliere fenomeni di drift – dal cambio nei pattern di utilizzo ai mutamenti nei dati di input – e, se necessario, riportata a uno stadio precedente in pochi minuti. L’effetto è una riduzione drastica dei tempi di rilascio: quel che prima richiedeva settimane si compie ora in poche ore.

Infine, l’adozione dell’AI non si esaurisce nell’installazione di strumenti: è un viaggio che collega infrastrutture tecnologiche e mindset delle persone. Nelle organizzazioni dove nascono community interne, ingegneri e manager condividono sfide e piccoli trionfi, scambiando intuizioni e creando sinergie inattese. I momenti di formazione su casi reali, gli hackathon tematici e le sessioni di co-creazione aprono la strada a idee che spesso sfociano in nuovi prodotti o servizi, svelando applicazioni dell’AI in settori che pochi avrebbero immaginato.

Oltre la delusione, un bilancio positivo

Il trough of disillusionment si rivela, in realtà, l’alba di un nuovo capitolo: le tecnologie sono leve concrete di ottimizzazione. Le organizzazioni che hanno superato il confronto con i primi insuccessi raccontano storie di miglioramenti misurabili: riduzione dei costi operativi, aumento della qualità dei prodotti e servizi, migliore soddisfazione dei clienti.

In questo nuovo scenario, l’AI diventa parte del Dna aziendale, un ingrediente che si mescola alle competenze umane per amplificare risultati piuttosto che sostituirli. Le aziende iniziano a monitorare dashboard in tempo reale, non per rincorrere l’ultima tendenza, ma per controllare indicatori chiave di performance – dal tempo medio di intervento nelle linee produttive all’accuratezza delle previsioni di vendita.

Guardando al futuro, la vera sfida sarà mantenere questo slancio: consolidare le pratiche etiche e di governance, aggiornare continuamente i modelli con dati freschi e rilevanti, e coltivare un mindset che riconosca l’AI come un processo in continua evoluzione. Solo così il motore dell’intelligenza artificiale potrà alimentare non un lampo di entusiasmo, ma un’innovazione duratura, capace di trasformare interi settori e di offrire alle imprese un vantaggio sostenibile nel tempo.

__

*Fabrizio Milano d’Aragona, esperto di AI, coordina il Think Tank sull’intelligenza artificiale in Assintel

© RIPRODUZIONE RISERVATA