OpenAI e Nvidia hanno reso pubblica una lettera d’intenti che dà il via ad operazioni infrastrutturali ambiziose per lo sviluppo dell’intelligenza artificiale. L’accordo prevede la costruzione e la distribuzione di almeno dieci gigawatt di sistemi Nvidia dedicati a sostenere la futura infrastruttura di OpenAI, con un impegno di investimento da parte di Nvidia fino a cento miliardi di dollari, man mano che ciascun gigawatt verrà effettivamente dispiegato. La prima fase del programma, basata sulla piattaforma Vera Rubin, è attesa per la seconda metà del 2026 e rappresenta l’avvio di un percorso che, nelle intenzioni, dovrebbe ridefinire i confini della capacità computazionale per l’AI. Gli accordi si innestano in una collaborazione di lungo corso. OpenAI sin dagli albori ha scelto di affidarsi ai sistemi di Nvidia per avviare la propria ricerca e lo sviluppo dei primi modelli.

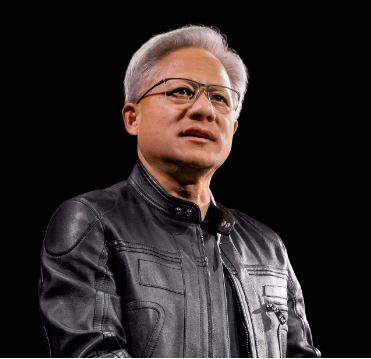

Spiega Jensen Huang, Ceo e presidente di Nvidia: “Da dieci anni Nvidia e OpenAI si stimolano a vicenda – dalla realizzazione del primo supercomputer Dgx fino alla svolta rappresentata da ChatGpt -. Questo investimento e la nuova partnership infrastrutturale segnano il prossimo salto in avanti ]…[“. Oggi, l’alleanza si estende, si consolida e scala in un momento in cui i requisiti di calcolo per l’AI stanno crescendo in maniera esponenziale. I modelli multimodali, agentici e a ragionamento esteso richiedono infrastrutture potenti e flessibili, in grado di sostenere sia le fasi di addestramento sia quelle di inferenza. OpenAI ha bisogno di una vera e propria “fabbrica” dell’intelligenza artificiale, capace di scalare parallelamente su milioni di Gpu. Nvidia, dal canto suo, consolida la propria posizione come partner preferenziale nel computing accelerato, rafforzando un ruolo che non si limita più alla fornitura di hardware ma abbraccia sempre di più la dimensione infrastrutturale e strategica.

I vantaggi per OpenAI

Per OpenAI, i vantaggi sono molteplici. La disponibilità di dieci gigawatt di capacità garantisce un accesso stabile e scalabile a risorse di calcolo che altrimenti rischierebbero di diventare un collo di bottiglia per la ricerca e lo sviluppo dei nuovi modelli.

La collaborazione diretta con Nvidia permette di allineare la roadmap hardware con le esigenze software, lavorando fianco a fianco sull’ottimizzazione delle librerie, dei compilatori e degli algoritmi in modo che possano sfruttare meglio l’architettura sottostante. Ciò si traduce in guadagni di efficienza non solo sul piano della velocità di addestramento, ma anche sulla gestione dei consumi energetici e sul throughput per watt. A ciò si aggiunge l’impegno finanziario di Nvidia, vincolato all’avanzamento del dispiegamento, che consente a OpenAI di contare su risorse rilevanti per sostenere non soltanto l’acquisto dei sistemi, ma anche la costruzione delle infrastrutture collaterali, dai data center alle reti, dal raffreddamento all’alimentazione. È lo stesso Ceo, Sam Altman a sottolineare come l’obiettivo di lungo termine sia quello di “ridurre progressivamente il costo marginale dell’intelligenza, spostando più in alto l’asticella sul fronte della ricerca e aumentando la disponibilità di capacità computazionale a supporto dei modelli futuri”.

I vantaggi per Nvidia

Nvidia, dal canto suo, trae vantaggio da una domanda assicurata su scala globale. Avere OpenAI come partner preferenziale significa consolidare un mercato di enorme valore, in cui l’adozione dei suoi sistemi è garantita e continuativa. Questo effetto si estende ben oltre la singola partnership, perché consolida lo stack tecnologico di Nvidia come standard di riferimento per l’intero ecosistema dell’intelligenza artificiale.

La diffusione delle sue Gpu e delle relative librerie software in ambienti di produzione di questa portata spinge inevitabilmente sviluppatori, ricercatori e aziende terze a privilegiare la compatibilità con i sistemi Nvidia, con gli Sdk e con i tool di ottimizzazione già consolidati. Un ulteriore beneficio per Nvidia è rappresentato dalla possibilità di raccogliere dati di telemetria e feedback su larga scala direttamente con uno dei player di riferimento del settore. La gestione di carichi di lavoro di questa entità fornirà insight preziosi sul comportamento dei modelli più complessi, permettendo cicli di miglioramento hardware e firmware più rapidi ed efficaci. L’aspetto finanziario non è meno rilevante: l’impegno a investire fino a cento miliardi di dollari in OpenAI è un segnale forte al mercato, non solo di fiducia reciproca, ma anche di volontà di rafforzare la propria posizione al centro delle alleanze che ruotano attorno all’ecosistema AI. Questo colloca Nvidia come interlocutore “privilegiato” non solo di OpenAI, ma anche dei suoi partner e investitori globali, da Microsoft a Oracle, da SoftBank alle realtà coinvolte nel progetto Stargate.

Le sfide

© RIPRODUZIONE RISERVATA