Entro il 2027, solo un’organizzazione governativa su quattro disporrà di servizi rivolti ai cittadini abilitati dall’intelligenza artificiale generativa. Lo dice Gartner che attinge i dati dal suo studio annuale Cio Agenda. Coinvolge oltre 2.400 tra Cio e responsabili tech a livello globale e rileva che il 25% dei governi ha sì implementato o prevede di implementare servizi basati sulla GenAI nei prossimi 12 mesi, mentre un ulteriore 25% prevede di implementarla nei prossimi 24 mesi, ma anche che, soprattutto nelle prime fasi, l’attenzione sarà concentrata sulla creazione di un quadro di governance a supporto delle sperimentazioni necessarie e quindi di progetti di adozione decisamente ristretti e limitati.

Come tutti i settori, anche le pubbliche amministrazioni negli ultimi 15 mesi hanno esplorato opportunità e rischi associati all’utilizzo della GenAI.

Alla base della prudenza nell’approccio c’è però, secondo l’analisi, il timore di un fallimento pubblico e la mancanza di fiducia delle comunità nell’uso di tecnologie così sensibili da parte dei governi. Fattori che rallenteranno l’adozione dell’AI utilizzata per i cittadini.

Spiega meglio Dean Lacheca, VP analyst di Gartner: “Mentre i governi beneficiano da anni dell’uso di tecnologie AI mature, rischi e incertezza rallentano l’adozione di GenAI su larga scala, in particolare per la mancanza di controlli tradizionali per mitigare possibili derive ed errori”. Non solo, anche la mancanza di empatia nell’erogazione dei servizi e l’incapacità di soddisfare le aspettative delle comunità potrebbero “minare l’accoglienza da parte del pubblico”.

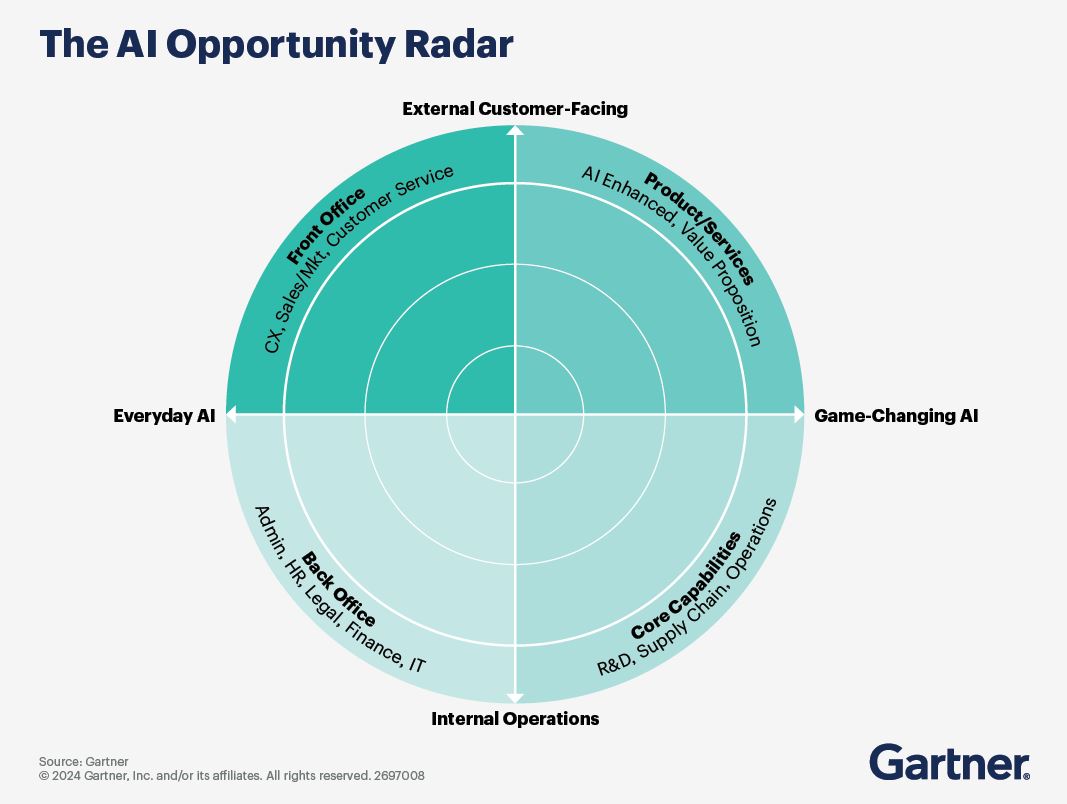

Anche per questi aspetti, gli analisti di Gartner suggeriscono di continuare a implementare attivamente soluzioni GenAI partendo da quelle che già ora possono comunque migliorare l’operatività interna, di back-office, dei servizi già in essere per i cittadini.

Prosegue infatti Lacheca: “L’adozione della GenAI da parte delle organizzazioni governative dovrebbe procedere a un ritmo allineato alla loro propensione al rischio, per garantire che i primi passi falsi (inevitabili, Ndr.) nell’uso dell’AI non minino l’accettazione da parte delle comunità sulla tecnologia integrata nei servizi governativi”. Lavorare sul back-office, prima che sul front-office è quindi mandatorio.

Oggi oltre il 60% dei Cio (nei diversi verticali) afferma che l’intelligenza artificiale fa parte del proprio piano di innovazione, ma meno della metà ritiene che l’organizzazione sia in grado di gestire i rischi. A questo proposito Gartner consiglia prima di tutto di decidere dove e come utilizzare l’intelligenza artificiale all’interno dell’organizzazione. Dato che l’AI di oggi può fare tutto, compreso decidere, agire, scoprire e generare, è altrettanto importante sapere per cosa non utilizzarla.

E tre sono i passaggi chiave da seguire/valutare: il primo riguarda la definizione delle ambizioni sui vantaggi che si pensa di voler conseguire (1); il secondo concerne invece come distribuire l’utilizzo dell’AI (2). Spieghiamo: le organizzazioni possono implementare l’intelligenza artificiale su modelli pubblici standardizzati addestrati su dati pubblici ma anche sfruttare un modello pubblico e dati adattati a database proprietari, o creare internamente un algoritmo personalizzato addestrato sui propri dati (metodo più complesso, che in tanti casi fino ad oggi ha frenato i progetti).

Maggiore è la personalizzazione, maggiori saranno i costi di investimento e i tempi di implementazione; tuttavia, una maggiore personalizzazione offre anche opportunità migliori. Il terzo passaggio riguarda i rischi (3). Risultati inaffidabili o ‘opachi’, rischi di violazione della proprietà intellettuale, preoccupazioni sulla privacy dei dati e sulle minacce informatiche sono certo da valutare, così come – e tanto più nella PA – esistono anche rischi normativi emergenti legati alle regole e alle restrizioni che diverse giurisdizioni possono imporre all’AI. E’ da definire quindi con cura la “propensione al rischio accettabile”.

Secondo Gartner, le organizzazioni governative potrebbero accelerare l’adozione della GenAI concentrandosi su specifici casi d’uso che incidono prevalentemente sulle risorse interne, evitando i rischi percepiti associati ai servizi esposti ai cittadini, ma intanto sviluppando conoscenze e competenze associate alla tecnologia e, soprattutto, preparandosi alla verifica dei dati, della loro prontezza per questi specifici scopi di utilizzo.

Fiducia e rischi possono essere rispettivamente accresciuti e limitati stabilendo una governance trasparente dell’AI. “Si parla di specifici schemi d’uso che considerano in modo puntuale i rischi associati ai casi d’uso per quanto riguarda risultati imprecisi o fuorvianti, privacy dei dati etc. con i processi di governance strutturati in modo da considerare specificamente ciascun rischio sia prima che dopo l’implementazione iniziale”, chiude Lacheca. Infine le pratiche di progettazione dovrebbero essere incentrate sulle persone e sull’empatia così da mantenere le soluzioni ed i servizi in linea con le aspettative della comunità soprattutto per quanto riguarda come e quando dovrebbero essere utilizzate.

© RIPRODUZIONE RISERVATA