Il colloquio di selezione è lo strumento più usato per valutare i candidati. È anche uno dei meno affidabili quando si basa sull’intuizione del sele zionatore. E c’è una frase che ricorre nelle riunioni di selezione con una frequenza inversamente proporzionale alle prove che la supportano: “Io i talenti li riconosco subito”.

Chi la pronuncia lo fa con la stessa sicurezza con cui un sommelier annuncia l’annata a occhi chiusi. Gli studi di Frédéric Brochet all’Università di Bordeaux hanno mostrato che gli esperti di vino descrivono lo stesso identico vino in modo opposto a seconda della bottiglia in cui è servito. I risultati predittivi, a guardare i dati, non sono troppo distanti.

85 anni di ricerca in una cifra scomoda

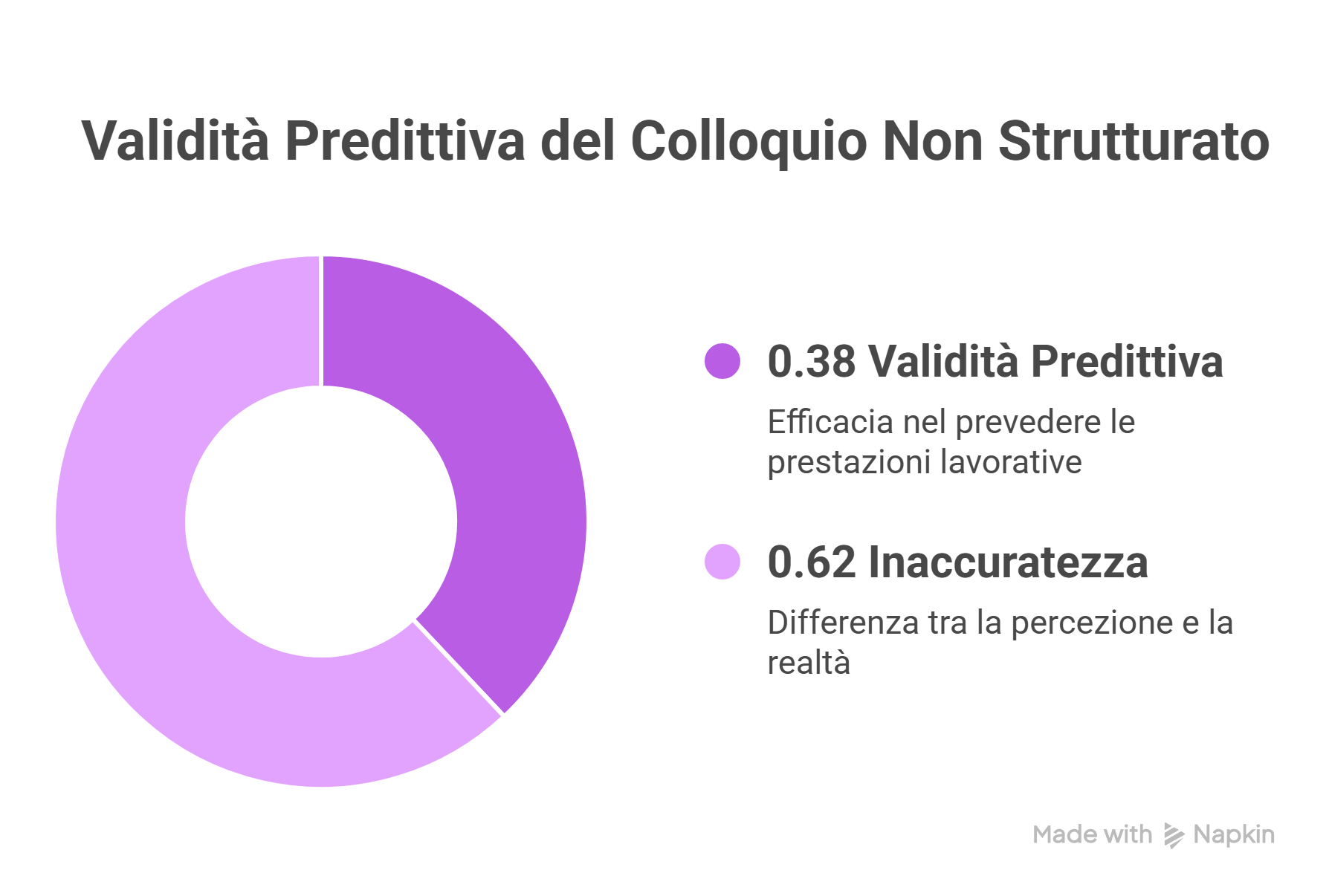

Nel 1998, Frank Schmidt e John Hunter pubblicano una meta-analisi che copre quasi un secolo di studi sulla selezione del personale. Il colloquio non strutturato — quello in cui si “segue l’istinto”, si esplora la personalità, ci si fida dell’impressione — ottiene una validità predittiva di 0,38 su scala 1. Non è un disastro assoluto. È però significativamente inferiore a quello che i selezionatori credono di ottenere, e crolla ulteriormente quando la valutazione si riduce a “ho una buona sensazione”.

Il problema non è l’incompetenza di chi seleziona. È un meccanismo cognitivo preciso, identificato da Edward Thorndike già nel 1920: l’effetto alone (halo effect). Una caratteristica positiva — la comunicativa, la presenza, la stretta di mano ferma — tende a colorare la valutazione di tutto il resto. Il cervello non fa una media: costruisce una narrazione coerente a partire dal primo dato disponibile, e poi la difende.

Uno studio del 2024 pubblicato sull’International Journal of Selection and Assessment ha mappato sistematicamente le forme di bias più frequenti nel colloquio di lavoro. I selezionatori non si limitano ad ascoltare cosa dice il candidato: registrano come lo dice, con che accento, come appare fisicamente, come si veste. Fattori che con la performance lavorativa futura hanno una correlazione prossima allo zero.

Simile a me, lo specchio che assume

A fianco dell’effetto alone opera un secondo meccanismo, altrettanto documentato: il bias similar to me. La tendenza a valutare più favorevolmente chi condivide background, stile comunicativo, percorso formativo. Non perché il valutatore sia in malafede. Perché la familiarità viene elaborata inconsciamente come segnale di competenza.

Secondo un sondaggio CareerBuilder su oltre 2.000 responsabili HR, circa la metà ammette che i bias influenzano le proprie decisioni di assunzione. Le persone tendono naturalmente verso chi ricorda loro stesse e condivide le loro prospettive.

La ricercatrice Lauren Rivera ha studiato il processo di selezione nelle grandi società di consulenza e finanza d’élite negli Stati Uniti. Il risultato è che i selezionatori non valutavano tanto le competenze tecniche, quanto la “chimica”: la sensazione di poter andare a cena con il candidato, di condividere gli stessi hobby, di riconoscersi in qualcuno. Il talento riconosciuto subito, in molti casi, è semplicemente qualcuno che assomiglia a chi valuta.

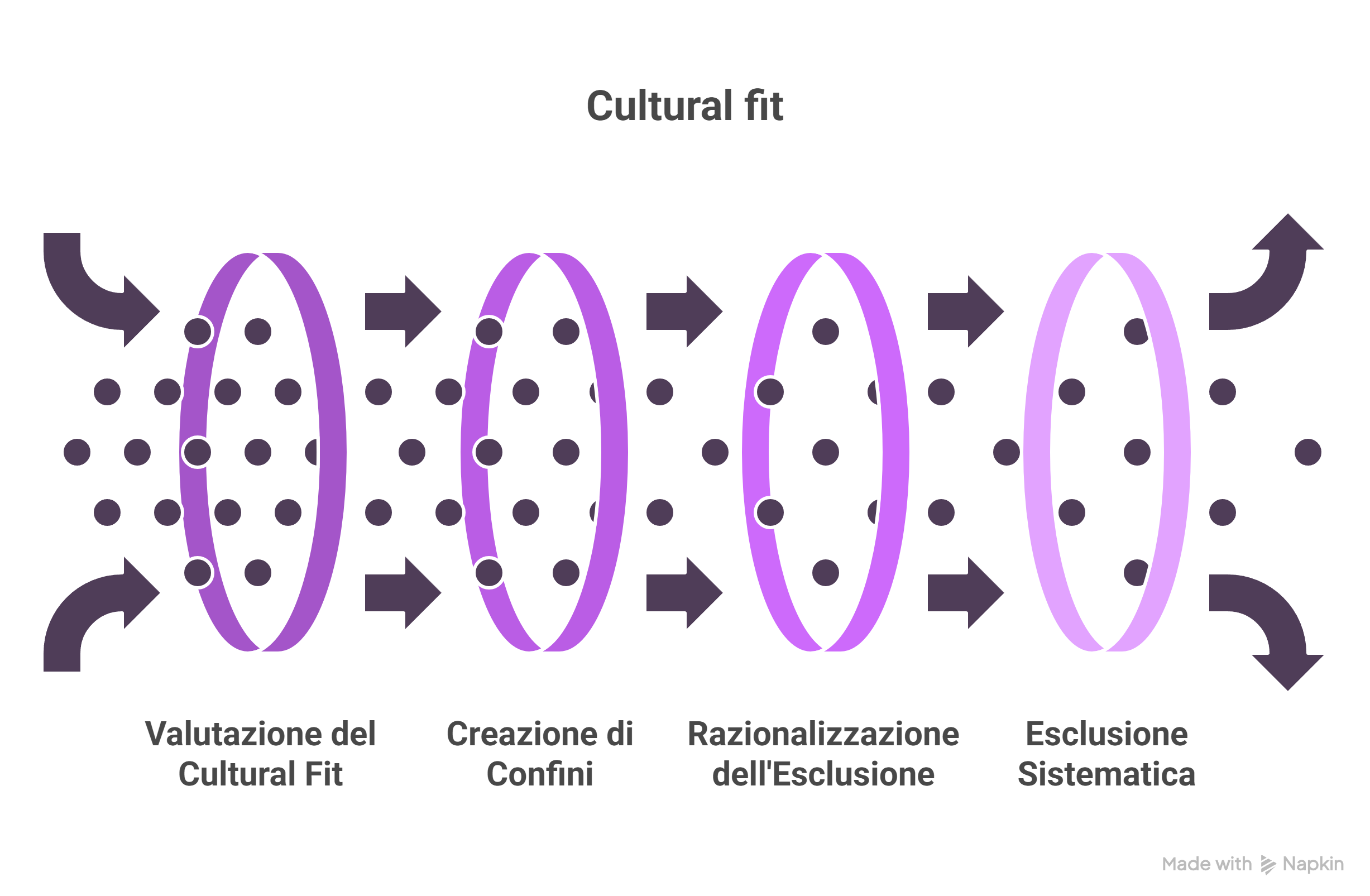

Cultural fit, ovvero l’esclusione elegante

Negli ultimi vent’anni il vocabolario della selezione si è arricchito di una formula che merita attenzione: cultural fit. In italiano suona come “compatibilità culturale”, ma funziona spesso come qualcosa di più sottile. Uno studio del 2024 su 47 consulenti di recruiting (Matching Candidates to Culture, Tholen) ha mostrato che il “cultural fit” viene usato per creare e giustificare confini tra candidati accettabili e inaccettabili, razionalizzando ed escludendo gruppi in modo sistematico — nonostante le politiche di diversity dichiarate.

Una ricerca del 2025 pubblicata su World Englishes ha analizzato colloqui reali in una grande agenzia di recruiting. La conclusione è netta: i candidati meno familiari con le regole non dette del gioco di potere mascherato da “conversazione amichevole” vengono penalizzati ed etichettati come inadatti culturalmente.

Detto altrimenti: cultural fit è spesso il nome elegante che si dà all’esclusione di chi non ha imparato — per nascita, contesto, classe sociale — le forme giuste. Non è una valutazione del talento. È una valutazione dell’accesso.

Il paradosso dell’etichetta

C’è un terzo problema, meno discusso. Il framework di Carol Dweck sulla mindset, suggerisce un’implicazione spesso trascurata: etichettare qualcuno come talento in modo precoce e assoluto può produrre effetti opposti a quelli desiderati. Chi viene identificato come naturalmente dotato tende a sviluppare una relazione difensiva con il fallimento: sbagliare minaccia l’identità, non informa l’apprendimento. Il talento diventa una gabbia dorata. L’organizzazione che ha “riconosciuto subito” il talento si ritrova a gestire qualcuno che evita i rischi, performa nei contesti sicuri e si blocca dove servirebbe sperimentare. Il prezzo del riconoscimento precoce può essere alto.

Il costo del fiuto

Non si tratta di questioni etiche astratte. Un report McKinsey rileva che le aziende nel quartile superiore per diversità etnica e culturale hanno il 36% di probabilità in più di sovraperformare quelle nel quartile inferiore in termini di redditività. Non è una differenza marginale. Né le conseguenze sono solo economiche. Uno studio della Yale University analizza cosa succede quando lo stesso identico curriculum viene presentato con un nome maschile o femminile a un panel di professori universitari di materie scientifiche — persone addestrate per definizione al ragionamento oggettivo. I professori valutano il candidato “maschile” come significativamente più competente, e offrono uno stipendio iniziale circa 4mila dollari più alto rispetto alla candidata “femminile” con curriculum identico. Il fiuto discrimina benissimo, e in modo coerente. Solo che lo fa su criteri sbagliati.

Il bias non scompare con l’algoritmo. Si industrializza.

A questo punto qualcuno obietterà: ma se il problema è il giudizio umano, basta toglierlo dall’equazione. Affidarsi agli algoritmi, essere oggettivi per definizione.

L’argomento è ragionevole. La realtà è più scomoda.

Nel 2014 Amazon decise esattamente questo: costruire un sistema di AI per lo screening dei curriculum, capace di valutare migliaia di candidati e restituire i migliori cinque su cento. Il sistema assegnava da una a cinque stelle — come i clienti fanno con i prodotti Amazon. Elegante, scalabile, oggettivo. Il problema emerse nel 2015. L’algoritmo era stato addestrato su dieci anni di curriculum ricevuti dall’azienda — e poiché il settore tech è dominato da uomini, la maggior parte dei curriculum proveniva da uomini. Risultato: il sistema aveva imparato a preferire i candidati maschi. Penalizzava i curriculum che contenevano la parola “women’s” — come in “capitano della squadra femminile di scacchi”. Svalutava le laureate di alcuni college femminili. Privilegiava chi usava verbi tipicamente presenti nei curriculum maschili, come “executed” o “captured”.

Gli strumenti di AI non stavano eliminando il bias umano. Lo stavano lavando attraverso il software. Amazon tentò di correggere il tiro, non ci riuscì, e abbandonò il progetto.

Il caso Amazon non è un’eccezione. Uno studio dell’Università di Washington del 2024 ha testato tre dei principali modelli linguistici su oltre 550 curriculum reali, variando solo i nomi associati a candidati bianchi, neri, maschi e femmine. I modelli hanno favorito nomi associati a candidati bianchi nell’85% dei casi, nomi femminili solo nell’11%, e non hanno mai preferito un candidato maschio nero rispetto a uno bianco maschio con qualifiche identiche.

Uno studio su Pnas Nexus del 2025, che ha esaminato 361mila curriculum fittizi su cinque dei principali Llm disponibili — Gpt-3.5, Gpt-4o, Gemini, Claude, Llama — ha confermato il pattern: i modelli favoriscono sistematicamente le candidate femminili penalizzando al tempo stesso i candidati maschi neri, anche a parità di qualifiche. Non in modo uniforme: i bias operano in modo intersezionale, combinando genere e razza in pattern che sfuggono alle categorie semplici.

La ricercatrice Sandra Wachter dell’Università di Oxford ha sintetizzato il meccanismo con una frase difficile da ignorare: “Chiedi chi è stato il candidato di maggior successo in passato — e il tratto comune sarà probabilmente qualcuno di maschile e bianco”. Il similar to me non scompare con l’algoritmo. Viene codificato, reso opaco, scalato a milioni di decisioni — e diventa molto più difficile da contestare. Almeno il selezionatore umano può essere messo in discussione in riunione.

Cosa ha fatto Google e perché è utile saperlo

Laszlo Bock, per anni responsabile delle People Operations di Google, ha descritto in dettaglio l’evoluzione dei processi di selezione dell’azienda. Il punto di partenza era esattamente il modello del “fiuto”: i fondatori credevano di riconoscere i migliori a istinto, e selezionavano di conseguenza. I dati interni raccolti negli anni successivi mostrarono che le previsioni basate sull’intuizione non correlano con le performance reali in misura statisticamente significativa. Google passò a colloqui strutturati, criteri espliciti definiti prima dell’incontro con il candidato, panel di valutatori indipendenti. I colloqui strutturati predicono il successo lavorativo circa il doppio rispetto a quelli non strutturati. Non perché siano più romantici. Perché funzionano meglio.

Il fiuto esiste. Ma fiuta altro

Liquidare l’intuizione come inutile sarebbe scorretto. L’esperienza produce riconoscimento di pattern reale, e chi ha gestito decine di processi di selezione sviluppa sensibilità che non è riducibile a un algoritmo. Il punto è sapere cosa si sta fiutando. Spesso non è il talento: è la presentabilità, la fluidità verbale, la capacità di gestire l’impressione in un contesto ad alta posta. Tutte qualità utili in certi ruoli — e irrilevanti in molti altri. Chiamare tutto questo “talento” è più comodo che fare il lavoro di definire con precisione cosa si sta cercando, costruire criteri osservabili, confrontare le valutazioni tra più persone. Il fiuto è reale. La domanda è se serva a selezionare i migliori — o a selezionare chi ci somiglia, e chiamarlo un merito.

—

Fonti

Brochet, F. (2001), Chemical object representation in the field of consciousness. Università di Bordeaux.

Schmidt, F.L. & Hunter, J.E. (1998), The validity and utility of selection methods in personnel psychology. Psychological Bulletin, 124(2), 262–274.

Thorndike, E.L. (1920), A constant error in psychological ratings. Journal of Applied Psychology, 4(1), 25–29.

Wingate, T. et al. (2024), How does bias enter the employment interview? International Journal of Selection and Assessment. https://doi.org/10.1111/ijsa.12467

Rivera, L. (2015), Pedigree: How Elite Students Get Elite Jobs. Princeton University Press.

Shrm Labs & JobTwine (2023), Eliminating biases in hiring: Structured interviewing and AI solutions. https://www.shrm.org/labs

Tholen, G. (2024), Matching candidates to culture: How assessments of organisational fit shape the hiring process. Work, Employment and Society, 38(3), 705–722.

Bonelli, M. et al. (2025), The myth of cultural fit in recruitment job interviews. World Englishes. https://doi.org/10.1111/weng.12710

Dweck, C. (2006), Mindset: The New Psychology of Success. Random House.

McKinsey & Company (2020), Diversity wins: How inclusion matters. https://www.mckinsey.com

Moss-Racusin, C.A. et al. (2012), Science faculty’s subtle gender biases favor male students. PNAS, 109(41), 16474–16479.

Bock, L. (2015), Work Rules! Insights from Inside Google That Will Transform How You Live and Lead. Twelve.

Dastin, J. (2018), Amazon scraps secret AI recruiting tool that showed bias against women. Reuters. https://www.reuters.com

Wilson, K. & Caliskan, A. (2024), AI tools show biases in ranking job applicants’ names according to perceived race and gender. University of Washington. https://www.washington.edu/news/2024/10/31

An, J., Huang, D., Lin, C. & Tai, M. (2025), Measuring gender and racial biases in large language models: Intersectional evidence from automated resume evaluation. PNAS Nexus, 4(3), pgaf089.

Wachter, S. citata in: Cut the SaaS (2024), Case study: How Amazon’s AI recruiting tool “learnt” gender bias. https://cut-the-saas.com

* Laureato in ingegneria elettronica/sistemi informativi al Politecnico, Pierpaolo Muzzolon trascorre tutta la vita in aziende hi-tech e IT nel marketing e nella comunicazione, oggi è counselor in analisi transazionale, coach e trainer.

© RIPRODUZIONE RISERVATA