Dopo oltre due decenni di evoluzione graduale, durante i quali il cloud computing ha ridefinito la localizzazione e la scalabilità delle infrastrutture pur lasciando sostanzialmente invariate le architetture di base, il settore dei data center si trova oggi al centro di una nuova ondata di cambiamento che accelera a una velocità che, secondo gli analisti, non ha ad oggi pari termini di confronto. Al cuore di questa trasformazione ci sono l’intelligenza artificiale e il calcolo accelerato, che agiscono come forze in grado di ridisegnare il modo in cui l’infrastruttura digitale viene concepita, distribuita e resa scalabile. Forte dell’esperienza e delle competenze maturate dal proprio team – per quanto riguarda energia, raffreddamento, sistemi IT, infrastrutture modulari prefabbricate e servizi avanzati di monitoraggio e manutenzione predittiva – e della prospettiva degli analisti di mercato, Vertiv offre una lettura dettagliata di questa evoluzione/rivoluzione.

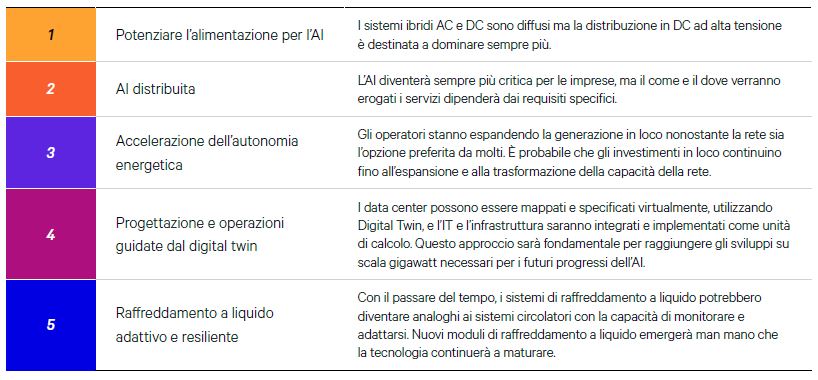

Attraverso l’identificazione di elementi strutturali e di cinque tendenze tecnologiche principali, Vertiv tratteggia la visione strategica per il data center del futuro: un sistema integrato, intelligente e resiliente, capace di sostenere i workload più intensivi garantendo al contempo efficienza energetica e continuità operativa.

Le forze in gioco che ridisegnano il data center

Prima ancora di entrare nel dettaglio delle singole tendenze tecnologiche, è fondamentale comprendere gli elementi chiave strutturali che stanno rimodellando il settore dall’interno. Vertiv ne identifica quattro principali, tra loro profondamente interconnesse.

Il più impattante è la densificazione: i workload legati all’AI e all’High Performance Computing (Hpc) stanno spingendo la potenza per rack ampiamente oltre i 25 kW, con punte a tre cifre che fino a pochi anni fa sembravano irraggiungibili. Sistemi che in passato occupavano intere sale server possono oggi essere concentrati in un singolo rack, con ricadute dirette sulla progettazione degli spazi, sistemi di alimentazione e soluzioni di raffreddamento.

A questo si affianca la scalabilità: i nuovi data center non vengono più costruiti in logica incrementale, ma concepiti fin dall’origine per crescere rapidamente da decine di megawatt a campus multi-gigawatt. Blocchi infrastrutturali modulari prefabbricati, che integrano componenti di alimentazione, raffreddamento e IT, consentono una risposta veloce alle tempistiche compresse imposte dall’era dell’AI.

Il terzo elemento chiave è il progressivo emergere del data center come unità di calcolo perfettamente integrata: l’“unità di calcolo” non è più il singolo chip, ma l’intero sistema fisico. Alimentazione, raffreddamento ed elaborazione devono essere integrati in una singola architettura coerente, dal rack ai dispositivi in row fino all’intero sito. Questo cambio di paradigma impone una visione sistemica dell’intera struttura. Infine, la diversificazione del silicio: i chip che alimentano l’AI si stanno moltiplicando. Accanto alle tradizionali GPU compaiono TPU, silicio custom e nuovi form factor. Come nell’industria automobilistica — passata dai soli motori a benzina a ibridi, elettrici e a idrogeno — l’infrastruttura dei data center del futuro dovrà essere progettata per supportare l’intero spettro di chip e capacità di calcolo disponibili.

I trend tecnologici per il data center AI-ready

La gestione dell’energia (1) nei data center moderni è senza dubbio un primo aspetto critico. La maggior parte delle strutture legacy utilizza ancora distribuzioni ibride AC/DC dalla rete ai rack IT, con tre o quattro stadi di conversione e le inefficienze che ne derivano. Con il rapido aumento delle densità computazionali — spesso oltre i 300 kW per rack nelle piattaforme AI — questo approccio si avvicina ai suoi limiti strutturali. La risposta suggerita da Vertiv è il passaggio ad architetture di distribuzione DC ad alta tensione, che consentono riduzioni significative dei conduttori, delle perdite termiche e degli stadi di conversione. Le innovazioni già in corso includono le architetture a 800 Vdc, annunciate da Nvidia con il supporto di Vertiv, che permettono una distribuzione dell’energia sensibilmente più efficiente. Nel breve termine i sistemi ibridi AC/DC continueranno a coesistere, ma con la maturazione degli standard full DC, la distribuzione ad alta tensione è destinata a diffondersi sempre più negli ambienti hyperscale e nelle AI Factory. Questa tendenza si intreccia inoltre con la crescita dello storage energetico e lo sviluppo di microgrid DC integrate, aprendo la strada a una nuova generazione di infrastrutture autosufficienti.

Come l’intelligenza artificiale “distribuita” arriva alle aziende

I miliardi di dollari investiti fino ad oggi nei grandi modelli linguistici (Large Language Model) presuppongono un’adozione massiva da parte di consumatori e aziende. La capacità di inferenza AI (2) necessaria per supportare questo scenario potrebbe superare gli attuali investimenti in training. Il modo in cui i servizi AI verranno erogati, però, dipenderà dalle esigenze specifiche di ciascuna organizzazione. I settori altamente regolamentati — finanza, difesa, sanità — dovranno mantenere ambienti AI privati o ibridi per ragioni di sovranità dei dati, sicurezza e latenza. Secondo IDC, i servizi finanziari rappresenteranno oltre il 20% di tutta la spesa AI entro il 2028. Si prevede inoltre un passaggio dai modelli creati dai service provider ai modelli linguistici specifici del dominio (DSLM), sviluppati e gestiti on site direttamente dalle aziende, con ricadute importanti sulle decisioni infrastrutturali: più data center privati ottimizzati per l’AI, più strutture in loco e colocation dedicate.

Verso l’autonomia energetica del data center

Ancora prima dell’avvento dell’AI, i data center stavano già affrontando una sorta di “crisi energetica”. I grandi operatori cloud hanno più che raddoppiato il loro consumo di elettricità solo nel periodo tra il 2017 e il 2021. Oggi i data center arrivano ad assorbire circa il 4,5% di tutta l’elettricità prodotta negli Stati Uniti, con proiezioni che parlano di un ulteriore incremento fino al 9,1% entro il 2030. Secondo Deloitte, la domanda energetica dei soli data center AI negli Usa potrebbe aumentare anche di oltre 30 volte entro il 2035, passando da 4 a 123 gigawatt. In questo contesto, la generazione di energia in loco (3) si sta trasformando da soluzione di emergenza a componente strategica dell’infrastruttura. Le tecnologie adottate includono turbine a gas naturale, microreti DC con solare e accumulo con sistemi Bess (Battery Energy Storage System), e — in prospettiva — celle a combustibile a idrogeno e piccoli reattori modulari (SMR) con capacità media di 300 MW. Il modello emergente è quello del Bring Your Own Power & Cooling (BYOP&C), adattabile lungo tutto lo spettro dei data center, dagli enterprise agli hyperscale.

Digital twin, un aiuto per disegnare il DC del futuro

I digital twin (4) rappresentano una delle innovazioni più rilevanti per la progettazione e la gestione dei data center. Utilizzati in passato in modo “tattico” per ottimizzare il raffreddamento tramite fluidodinamica computazionale (CFD), oggi — grazie all’AI e a piattaforme come Nvidia Omniverse — i gemelli digitali stanno diventando strumenti strategici capaci di modellare in modo sempre più realistico l’intera architettura di riferimento. Un digital twin avanzato facilita la collaborazione in tempo reale tra architetti, ingegneri e operatori, la simulazione virtuale delle prestazioni infrastrutturali, il test di scenari di guasto prima che si verifichino nel mondo fisico, e l’ottimizzazione a ciclo chiuso delle operazioni. Combinando l’approccio “data center come unità di calcolo” con la tecnologia dei digital twin, gli operatori possono progettare, implementare e gestire strutture con livelli crescenti di efficienza e resilienza, raggiungendo la scala gigawatt necessaria per i futuri progressi dell’AI.

Liquid cooling al servizio delle AI factory

Il liquid cooling (5) è passato da tecnologia di nicchia riservata ai laboratori HPC a sistema termico a supporto delle AI factory. Secondo Dell’Oro Group, l’utilizzo del raffreddamento a liquido crescerà di cinq,ue volte entro il 2029, diventando una delle tecnologie di riferimento per la dissipazione del calore man mano che le densità dei rack aumentano. Il contributo dell’AI non si limita però a spingere la domanda in questa direzione: l’AI può anche ottimizzare la progettazione e il funzionamento dei sistemi di raffreddamento. Sensori integrati nei circuiti termici, software specializzato per la manutenzione predittiva, materiali intelligenti per l’autoriparazione e robot autonomi per ispezione e manutenzione sono le componenti di un sistema di raffreddamento che, in futuro, potrebbe funzionare come un vero e proprio apparato circolatorio digitale: capace di monitorarsi, adattarsi e rispondere in autonomia agli stress operativi.

Uno sguardo oltre, il data center… in prospettiva

Oltre alle cinque tendenze chiave di breve-medio periodo, Vertiv individua un’ulteriore ondata di innovazioni con il potenziale di ridefinire profondamente l’infrastruttura digitale negli anni a venire. Il quantum computing e il computing neuromorfico aprono nuove frontiere di elaborazione, con requisiti architetturali radicalmente diversi — dal raffreddamento criogenico per i sistemi quantistici ai carichi dinamici altamente volatili delle Npu neuromorfiche.

I data center in ambienti estremi — subacquei, sotterranei, persino nello spazio — da argomento “speculativo” entrano nei dibattiti riguardo possibili implementazioni concrete, come dimostrano il Project Natick di Microsoft e i recenti annunci di OpenAI e Samsung su strutture galleggianti. L’AI fisica e la robotica ridisegneranno le strutture stesse dei data center, riducendo la dipendenza dall’intervento umano e accelerando ulteriormente la densificazione. Infine, l’Agi — l’intelligenza artificiale generale — se e quando emergerà nelle forme oggi ipotizzate, potrebbe contribuire a trasformare non solo i workload, ma anche i sistemi di gestione e controllo dell’infrastruttura stessa.

Il messaggio centrale di Vertiv è chiaro: il data center non è più un semplice edificio che ospita server. È un sistema integrato, progettato e gestito come un’unica unità di calcolo, in cui alimentazione, raffreddamento e potenza computazionale devono operare in perfetta sinergia. Comprendere questa trasformazione non è solo una questione tecnica: è una condizione indispensabile per guidare investimenti consapevoli, sviluppare infrastrutture digitali resilienti e restare competitivi in un mondo sempre più definito dall’AI. Le organizzazioni — dagli hyperscaler agli operatori enterprise — che sapranno adottare con tempismo le tecnologie adeguate (Digital Twin, DC ad alta tensione, liquid cooling avanzato, generazione energetica in sito) saranno meglio posizionate per sostenere i workload AI più intensivi, garantire efficienza operativa e supportare la crescita continua delle applicazioni basate sui dati. Il futuro del data center si costruisce oggi, e le scelte infrastrutturali di questo decennio definiranno la capacità competitiva del prossimo.

Per saperne di più scarica il whitepaper: Frontiers, le tendenze tecnologiche che plasmano il futuro del data center

Leggi tutti gli approfondimenti della Room: La nuova frontiera dei data center AI

© RIPRODUZIONE RISERVATA